Reconnaissance faciale dans le tram de Nice, géolocalisation dans les rues de Lannion et commerce des données par La Poste. Dans son livre-enquête, le journaliste Olivier Tesquet raconte comment la France bascule dans le capitalisme de surveillance.

En apparence, vous pouvez y voir une simple montre. Allez, une montre customisée vu qu’elle reçoit des messages et qu’elle permet de lancer de la musique dans vos écouteurs. Pourtant, l’Apple Watch n’est rien de moins qu’un « bracelet électronique qu’on achète pour soi », selon le journaliste Olivier Tesquet, auteur d’À la trace : enquête sur les nouveaux territoires de la surveillance. Dans ce manuel pour « ceux qui pensent qu’ils n’ont rien à cacher », le journaliste explique à quel point nous sommes fliqués et que ces dispositifs de surveillance « sont d’autant plus efficaces que nous ne les voyons plus ». À l’image de nos smartphones, fétiches de ce « capitalisme de surveillance » – un concept développé par Shoshana Zuboff. Ce qui ne risque pas de s’arranger avec la reconnaissance faciale souhaitée par le gouvernement.

De son propre aveu, Olivier Tesquet fait pourtant partie d’une génération qui pensait qu’Internet « serait un sésame vers la liberté ». Au début des années 2010, le web rimait avec les Printemps Arabes ou Wikileaks et ses révélations d’utilités publiques. Aujourd’hui, ça correspond surtout aux fake news, écoutes et reconnaissance faciale. Dans son livre, le journaliste de Télérama s’est intéressé aux acteurs « clandestins ou semi-clandestins qui sont la courroie de transmission entre les entreprises privées et le public » qui prennent le citoyen en tenaille.

Vous avez commencé à vous intéresser à ces « territoires de la surveillance » il y a dix ans. Comment situez-vous cette décennie en terme de diminution de la vie privée ?

Le bilan comptable verse plutôt du côté anxiogène. Il n’y a pas vraiment eu de signes réjouissants. Les bonnes nouvelles de base se sont retournées contre nous. Les plateformes comme Facebook ou Google étaient au départ relativement bienveillantes. Elles permettaient une libre circulation de l’information, l’accès à tout un tas de personnes ou de connaissances en permanence. Aujourd’hui, on n’a plus les mêmes réflexions à leur sujet. Ce sont des oligopoles apparemment impossibles à réguler…

Est-ce que des choses vous ont surpris dans votre enquête ?

Je n’avais peut-être pas anticipé que les outils technologiques soient repris aussi rapidement par des régimes autoritaires. Et je n’avais pas imaginé que les démocraties libérales et occidentales soient aussi vite contaminées par ce pouvoir de la surveillance. Aujourd’hui, on a beau vivre objectivement dans une démocratie, on déploie de plus en plus de dispositifs de contrôle social, notamment à des fins policières. On est dans un monde où l’innovation technologique est devenu l’alpha et l’oméga, c’est tout ce qu’il reste au gouvernement pour exercer le pouvoir. La reconnaissance faciale en est un exemple frappant.

Sur ce sujet, la question actuelle n’est pas de savoir si on veut vivre dans une société où il y a la reconnaissance faciale mais sous quelles modalités on la déploie. Ce qui n’est pas la même question. Et cette mutation-là, je ne l’avais pas anticipé. En tous cas pas dans ces proportions.

Nos dirigeants politiques disent qu’il faut « prendre le train en marche »…

Oui, c’est ce dont Cornélius Castoriadis (un philosophe grec, ndlr) parlait il y a 30 ans. Il expliquait qu’à aucun moment on ne se préoccupe de savoir ce qui est souhaitable ou pas. On le voit avec les industriels qui parlent de la reconnaissance faciale : « La technologie existe, elle ne peut pas être désinventée ». Mais ce n’est pas ça le débat. La question qu’on se pose est une question morale et politique : « Est-ce que cette technologie apporte des choses positives dans une démocratie ? ». J’attends toujours qu’on y réponde. On va me dire : « Oui mais ça améliore la sécurité ». On se retrouve avec des expérimentations, comme pendant le carnaval de Nice…

Il y a également l’expérimentation faite par l’entreprise Two-I, qui a proposé à la mairie de Nice de faire des tests de reconnaissance faciale dans le tramway niçois ?

Oui. C’est l’un des problèmes avec toutes ces expérimentations. Tout se fait à l’échelle des villes qui sont devenues des laboratoires. La commande publique y est contournée par des entreprises qui démarchent elles-mêmes les municipalités et offrent des gadgets. C’est Two-I, une startup messine spécialisée en détection d’émotions, qui va démarcher Nice. Mais ce sont aussi les Américains Cisco qui vont voir la région Sud pour dire : « Si vous voulez, on installe des portiques de reconnaissance faciale à l’entrée des lycées ». Ce que la CNIL a interdit alors que les portiques ont été installés. C’est aussi Huawei qui va offrir des caméras de surveillance à Valenciennes.

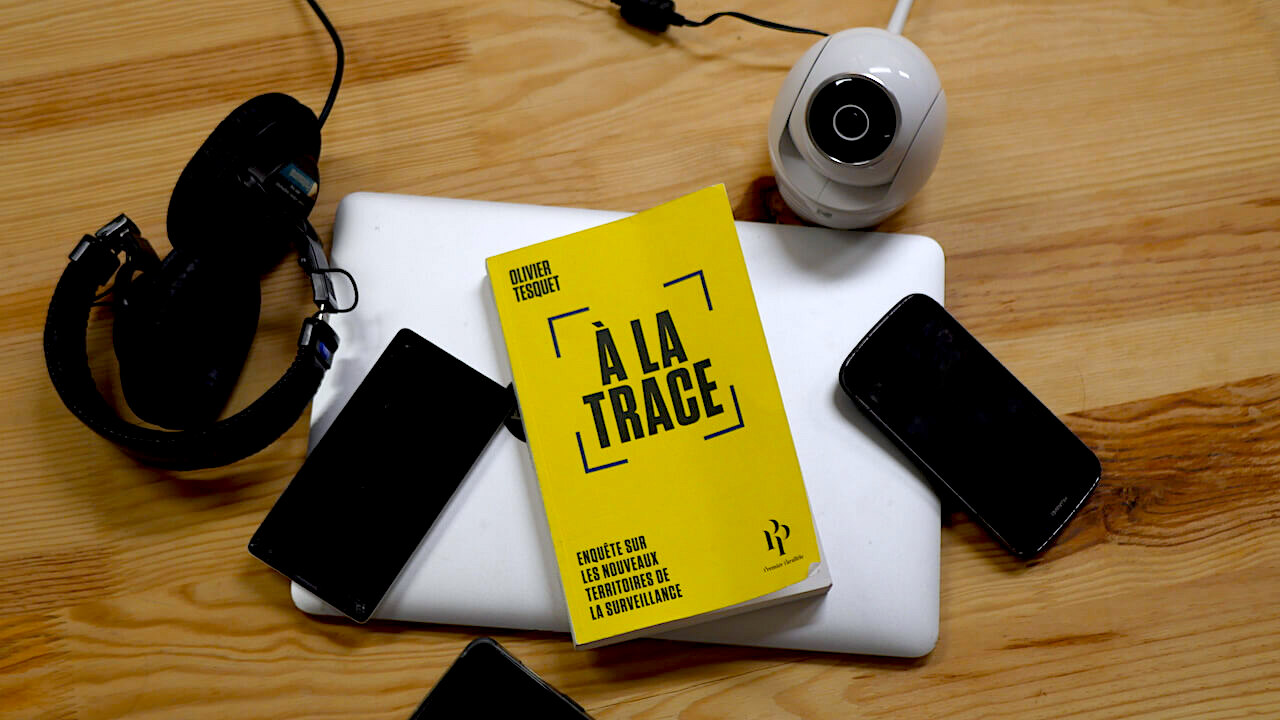

À la trace : Enquête sur les nouveaux territoires de la surveillance montre comment nous sommes les agents consentants de notre propre contrôle technologique. / Crédits : DR

Tout cela est un double contournement. De la commande publique d’abord, parce qu’il y a des marchés réglementés. Et ensuite du débat public, parce qu’à partir du moment où on a un échange de bons procédés de manière discrétionnaire, on est dans un système de contreparties. Car, lorsqu’une entreprise fait un cadeau comme ça, ce n’est pas de la philanthropie. Ils attendent quelque chose en retour. Les villes sont des laboratoires dont les habitants sont des cobayes mais qui ne sont absolument pas consultés.

Où en est le projet de cette startup messine ?

Ils ont approché la mairie de Nice et leur ont proposé de détecter les émotions des voyageurs dans les tramways de la ville. Ils prétendaient détecter les émotions des voyageurs pour repérer des suspects potentiels avant qu’ils ne passent à l’acte (le projet est depuis en suspens). Mais quand on sollicitait Nice, personne n’était capable de dire où ça en était. L’entreprise est ravie de communiquer sur l’interface mais dès qu’on veut creuser elle ne peut « entrer dans les détails ». Alors qu’on parle de pouvoir public ! Il faut aller chercher les éléments avec les dents. J’ai appris que cette startup avait signé des contrats avec « le ministère du Bonheur » de Dubaï. En France, ils ont testé leur dispositif au stade de football de Metz. La société n’a pas souhaité communiquer sur ce point. Il était aussi question qu’il soit testé dans un quartier populaire de Nancy, en partenariat avec l’office des HLM, pour évaluer le ressenti des habitants. Ce sont les deux groupes de population qui servent de cobayes aux expérimentations sécuritaires, comme s’ils s’agissaient de corps hors du droit sur lesquels on mesure les effets d’un dispositif avant de le déployer à la « population générale ».

Aujourd’hui il y a une fine cloison entre le public et le privé. Et sur les usages militaires ou publics, déployés à l’intérieur des villes. Thales est un bon exemple. C’est une entreprise de défense mais, aujourd’hui, leur axe de développement est la safe city. Une « ville sûre » bardée de capteurs et confiée à des ordinateurs. Parce que, lorsqu’on a installé 1.800 caméras, on a évidemment trop d’images donc il faut des logiciels pour les gérer. Ce qui équivaut à du déterminisme technologique ! Une fois qu’on est face à ces discours, c’est extrêmement difficile de s’en défaire.

Cela fait écho à la situation de Lannion, qui a installé des capteurs à smartphones, capables de suivre à la trace les trajets exacts des piétons. Sans que l’on sache ensuite ce qu’avait donné cette « expérience »…

Oui, tout se fait de manière expérimentale. À la décharge des municipalités, depuis qu’on a eu le RGPD, les villes n’ont plus l’obligation de faire une demande préalable de ces tests à la CNIL. Du coup, elles font du pilotage à l’aveugle. Ce qui m’interpelle, c’est qu’on voit des villes de 50.000 habitants seulement qui veulent leur « safe city ». Un industriel me disait que, depuis le début de l’année, il y avait une centaine de municipalités qui voulaient leur centre de surveillance urbains avec leur petit panneau de contrôle, leurs caméras… Les municipales approchent et la sécurité est toujours une martingale électorale. Tout le monde y va gaiement.

Est-ce que l’on suit le même schéma qu’avec la vidéosurveillance ?

Totalement. Les caméras ont été testées dans les grandes villes et maintenant il y en a dans des villages de 400 habitants. Lors du dernier forum Technopolis, le patron de l’association nationale de la vidéoprotection disait : « Il faut construire un modèle de reconnaissance faciale à la Française ». Je ne vois pas bien à quoi ça correspond face à un modèle de reconnaissance faciale à la Chinoise. C’est plus humaniste ? À ce sujet, on est d’une hypocrisie sans borne puisqu’on achète du matériel chinois pour ça, comme à Valenciennes avec les caméras de Huawei. Et n’oublions pas que les caméras piétons des policiers français sont achetés à Hikvision, une entreprise chinoise qui s’en sert pour identifier les Ouïghours. Cette entreprise est même interdite aux Etats-Unis.

L'entreprise chinoise Hikvision a mis au point une caméra capable d'identifier les Ouïghours (qui sont, rappelons-le, la cible d'une véritable épuration ethnique) https://t.co/4FqoM3qPyp

— Olivier Tesquet (@oliviertesquet) November 12, 2019

Rappel : Hikvision équipe aussi la police en caméras-piétons.https://t.co/YgWK6vz5lW

Dans votre livre, vous expliquez aussi qu’il y a un savoir-faire français en « arme numérique ». Quelles sont-elles ?

Les armes numériques, ce sont les technologies de surveillance. Ça m’a toujours surpris qu’on passe sous silence qu’on excelle dans ce domaine. Il y a les outils réservés aux services de renseignements, comme les systèmes d’écoute qu’on exporte à tout un tas de pays. Ercom est par exemple une société française qui vend des systèmes de surveillance en Égypte. Malgré cela, cette entreprise a toujours été soutenue par les services de l’Etat, qui ont besoin de son savoir-faire technologique, et elle a récemment été achetée par Thalès. %

L’autre domaine où l’on excelle, c’est la biométrie. On expérimente même des choses à Singapour pour ne pas avoir de comptes à rendre à la CNIL. On vend aussi des solutions biométriques à des anciennes colonies en Afrique, ce qui peut donner l’impression que la politique industrielle de la France en matière technologique est une continuation du colonialisme, par d’autres moyens. Un haut fonctionnaire de Bercy m’a d’ailleurs confirmé que la politique de la France en matière numérique est d’exporter un savoir-faire qui sert au profilage et au contrôle des populations.

La France a-t-elle un passif en terme de surveillance ?

Oui, si on a un tel savoir-faire en biométrie c’est parce qu’on a été des précurseurs. La France a inventé les fiches anthropométriques dont la reconnaissance faciale n’est jamais qu’une continuité. On avait le livret ouvrier (qui permettait le contrôle des horaires et des déplacements des travailleurs, ndlr), le carnet des nomades (instauré en 1912, il était obligatoire pour tous les nomades qui devaient consigner leurs déplacements, ndlr)…. À l’époque c’était des technologies qui concernaient des populations catégorisés comme dangereuses : pauvres, étrangers, criminels.. Aujourd’hui, on veut la déployer à l’ensemble de la population. Il faut se souvenir qu’il y a un siècle, si chaque Français avait dû se justifier de son identité à tout moment lors d’un contrôle de police, il y aurait eu des scandales. N’oublions pas que la carte d’identité a été imposée par Vichy. Ce glissement, on le revoit aujourd’hui avec la reconnaissance faciale.

À LIRE AUSSI : Bientôt dans presque tous les commissariats, un logiciel pour fouiller dans vos portables

Il y a un terme que nous connaissons peu et qui semble central dans cette société de surveillance, ce sont les « data brokers ». Qu’est-ce que c’est ? Quel est leur rôle ?

Ce sont les courroies invisibles, les petites mains de ce que la sociologue américaine Shoshana Zuboff appelle « le capitalisme de surveillance » (qui représente pour elle l’orientation et l’exploitation de nos préférences personnelles pour du profit, ndlr). Le terme a le mérite d’être assez clair. Ce sont des courtiers en données qui permettent aux grandes plateformes d’être où elles sont dans l’économie d’aujourd’hui. Ces sociétés n’ont pas vocation à être visibles du public, elles n’ont pas pignon sur rue. On ne décide pas sciemment d’aller se créer un profil chez elles, ce sont elles qui ont un profil de nous, à notre corps défendant. Il y a eu l’histoire d’une journaliste américaine qui s’est rendue compte que plus de 200 « data brokers » avaient des profils sur elle. Quand elle a voulu se retirer des bases de données, soit ce n’était pas possible, soit il fallait fournir d’avantage d’infos ! Avec celles-ci, les courtiers de données ordonnent la population selon un certain nombre de catégories. On est tous assignés à une place à laquelle il est difficile d’échapper.

Vous parlez des catégories USA. Ils décident des emprunts que vous pouvez contracter grâce aux infos que les data brokers ont de vous. Les plateformes entretiennent des liens très étroits et toxiques avec eux. Au moment du scandale Cambridge Analytica, Facebook indique qu’ils vont faire un audit et avance le chiffre de quelques centaines de data brokers. Un an et demi plus tard, on a découvert qu’il y avait en fait 69.000 chasseurs de données. Ça montre qu’il y a un tout un monde clandestin derrière les plateformes.

Certaines de ces entreprises sont françaises ?

Oui, on a Criteo par exemple. Ils ont récemment perdu 15 points en bourse suite à l’annonce de Google de limiter les cookies – car moins il y a de traceurs, moins ces entreprises ont de bénéfices. Mais il y a aussi la Poste qui est un très gros courtier en données. Ça devient une fonction primaire de toutes entreprises traitant des données personnelles. Et on appelle ça poliment de la « diversification ». Comme ils sont assis sur des données, ils veulent les exploiter car il y a de l’argent à se faire. On voit bien que la frontière entre ce qui est censé être un service public et la monétisation de ces informations a l’épaisseur d’une feuille de papier à cigarettes. La Poste a une base de données qui est très grande. Quand tu fais une campagne électorale, si tu peux récupérer ou acheter des fichiers à la Poste, ça peut être très utile. Mais ce genre d’accord reste assez peu documenté.

Toutes les infos personnelles que nous donnons volontairement ou non sont donc monnayables ?

Tout est effectivement monnayable. Dans le livre de Shoshana Zuboff, « Le capitalisme de surveillance », elle dit que nous en sommes le carburant. C’est le fameux : « Si c’est gratuit, c’est vous le produit ». Mais nous sommes même plus que ça. Nous sommes mis au travail et nous représentons des petites fourmis ouvrières de cette grande machine qui tourne en permanence. Mais je n’aime pas le terme « données personnelles ». Il fait qu’on se sent très seul face aux plateformes et à la surveillance alors que tout ceci se joue à une échelle sociétale.

Est-ce qu’il y a des secteurs qui ne sont pas surveillés aujourd’hui ?

C’est une des questions que je me posais : Est-ce qu’on est arrivé à un stade suprême de la surveillance ? À partir du moment où la croyance technologique a investi tous les secteurs, c’est difficile d’identifier des territoires qui seraient préservés… On va même coller des capteurs sur des vaches dans les exploitations agricoles ! À partir de là, je ne vois pas bien ce qui peut y échapper.

Olivier Tesquet est journaliste à Télérama et cartographie depuis dix ans les territoires de la surveillance. / Crédits : DR

Je pense que la reconnaissance faciale sera la nouvelle frontière de la vie privée dans les cinq ou dix ans à venir. Mais alors, si tout le monde se fout des données personnelles, la reconnaissance faciale ça intéresse.

Dans votre ouvrage, vous parlez des pistes pour lutter contre cette surveillance…

Il y a en effet des choses intéressantes dans les arts numériques pour contourner la reconnaissance faciale. Je pense à Adam Harvey, artiste américain qui travaille sur ces questions. Il a fait des vêtements anti-drones et a lancé des maquillages pour lutter contre la reconnaissance faciale. Il n’y a pas besoin de disparaître mais d’apparaître autrement. Les maquillages servent à déséquilibrer son visage car la reconnaissance faciale a besoin d’une espèce de symétrie parfaite. C’est terrible d’ailleurs, ce besoin de la perfection, que les yeux ou les commissures des lèvres soient parfaitement alignés… Donc, les gens se mettent un faux oeil, une fausse mèche de cheveux, afin de duper la machine. Comme à Hongkong où ils ont utilisé leurs cheveux. Après ça peut donner l’impression que ce sont des petits gestes, l’équivalent de pisser sous la douche pour sauver la planète.

Justement, il y a pour vous un parallèle à faire entre la lutte contre le réchauffement climatique et la lutte contre la surveillance généralisée ?

Oui, les deux discours ont émergé dans les années 70. Et aujourd’hui, on est dans un contexte de désastre écologique et technologique, qui commence à être interprété comme les symptômes d’une crise du capitalisme. Je crois à une convergence des luttes entre les préoccupations environnementales et technologiques. Comme sur la 5G par exemple. C’est un non-sens écologique – car ça fait tourner des machines encore plus puissantes qui consomment de l’énergie – et c’est aussi le moyen de mettre en œuvre des dispositifs de surveillance toujours plus invasifs. Les industriels le disent : les marchés qui vont profiter le plus de la 5G sont justement l’automatisation de la vidéosurveillance et les objets connectés qu’on a fait rentrer chez nous.

C’est d’ailleurs un paradoxe car nous faisons volontairement entrer dans notre intimité ces objets connectés.

C’est le paradoxe du confort et de l’inconfort. On a un confort d’utilisation car avec la technologie tout est plus simple. Moi-même, j’ai un smartphone, je suis sur Instagram… Je ne suis pas en dehors de ce que je décris. Je ne suis pas différent. Mais il y a un inconfort créé par l’opacité de ces dispositifs. De fait, on apprend des choses petit à petit. Comme le fait que Facebook active notre géolocalisation en permanence. Il y a aussi eu cette étude américaine qui a conclut que nos téléphones ne nous écoutent pas activement, une question qui revient très souvent, mais que tout un tas d’applications filment ce qu’il se passe sur notre écran. Au final, est-ce qu’on reçoit une information parce que notre téléphone nous a écoutés ? Ou est-ce qu’on la reçoit parce qu’à force d’être mesuré en permanence et d’être ce cobaye sur lequel on a branché plein de capteurs, la machine a fini par nous envoyer exactement ce qu’on attendait ?